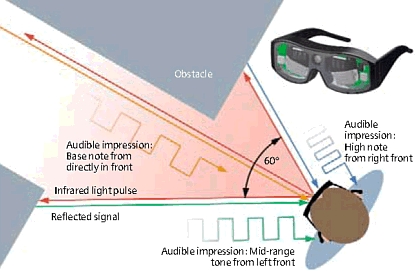

«La información procedente del mundo real es capturada mediante un sensor de imagen CMOS (Complementary Metal Oxide Semiconductor), capaz de adquirir información de la distancia de los objetos situados en un rango de 0 a 5 metros. En comparación con los métodos tradicionales de sensores, el sensor CMOS 3D propuesto combina una alta percepción de de sensibilidad, con bajos costes de producción y construcción y una integración hardware de pequeño tamaño. Esta información, básicamente distancias de los objetos situados en el punto de mira del hardware CMOS, ha de ser transformada en mapas acústicos. Para ello es enviada a una FPGA (Field Programmable Gate Array) con el software adecuado para finalmente, transformar y enviar la información a las personas invidentes.

El sistema final está compuesto por unas gafas, las cuales incluyen toda la electrónica láser necesaria para la captura de la información de las distancias, el ensamblado de los circuitos que componen la FPGA encargada de sonificar la información procedente del láser y unos auriculares, además de la batería para alimentar la circuitería y demás cableado.

El subsistema acústico es el encargado de reproducir sonidos espacializados, es decir, aquellos que serán escuchados por el usuario a través de los auriculares pero percibidos como si estuviesen situados en los objetos del entorno. Los sonidos han sido procesados previamente fuera de tiempo real de manera que se perciban situados en el entorno exterior al sujeto. Posteriormente se almacenan en la memoria del subsistema de sonidos. El subsistema selecciona en cada momento los sonidos que correspondan, los suma y reproduce el resultado por los auriculares

Víctor M. Santiago Praderas, Nuria Ortigosa, Larisa Dunai, Guillermo

Peris-Fajarnés

Centro de Investigación en Tecnologías Gráficas / Universidad Politécnica de Valencia

Valencia / España

[PDF completo del proyecto]

Leave a Reply

Lo siento, debes estar conectado para publicar un comentario.